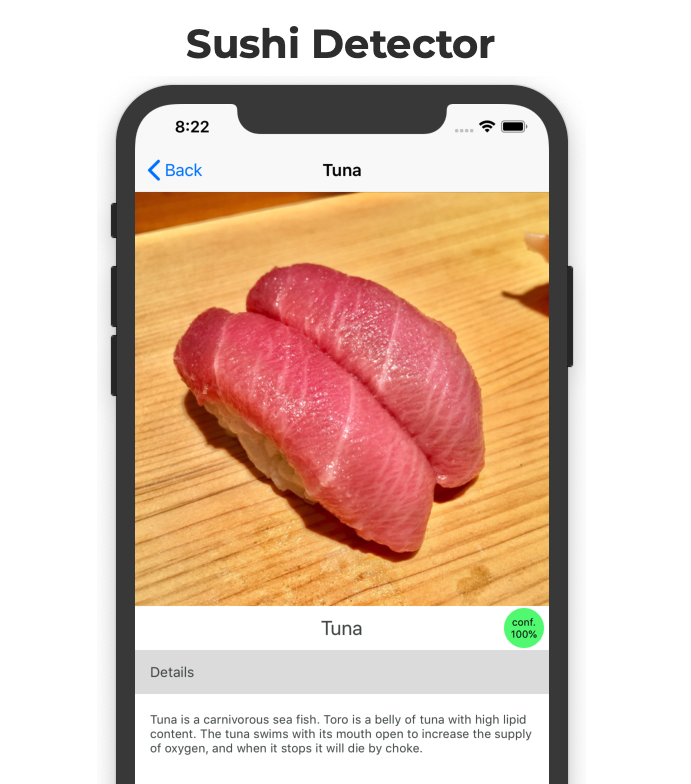

寿司画像分類アプリSushi Detectorをリリースしました。

デモ

とりあえずデモ

寿司画像分類アプリSushi Detector作った #sushi_detector https://t.co/L6AKuWZ9VH pic.twitter.com/DYxrQETxwO

— H. NOMATA (@hiromichinomata) 2019年6月25日

詳細

だいぶ出落ち感がありますが、寿司画像の認識アプリです。現状12種類に対応しています。

数年前にProductHuntのAward応募用に寿司分類アプリを作ろうと思って寿司画像を撮ったものの、ずっと放置。。。ある程度まとまった時間が取れるようになったので作ってみました。

使ったツールとか

- 言語、開発環境

SwiftとXcode。ビューはStoryBoardで作成。まあ普通ですね。

- 機械学習、画像認識

Create MLで学習させました。WWDCで独立GUIアプリ化発表されましたね。

データセットはスクレイピングと自分で撮った写真の半々。ネット上にある画像はどうしてもインスタ映えする画像が集まる傾向にあり、普通に撮った時の画像と乖離が大きかったのでこういうデータセットにしました。

写真はスーパーで買った寿司セットをスマホで撮っています。サラの種類や背景差分を物理レイヤーでやった結果、半日以上かかった。。。

- デザイン

Sketchで作成しました。illustratorと比べるとできることが少ない半面、操作自体は簡単だった。

苦労したこと

- 機械学習?

機械学習では前処理が9割と言いますが、画像認識アプリにおいても画像認識部分は1割程度の工数。お手軽学習機使った影響もありますが。データセット作成の方がはるかに時間かかっているので学習自体は1%以下。つらい。

- AppleによるReject

最初ドラマSilicon Valleyに登場するNot Hotdogをベースに作っていたら単純すぎるとRejectされた。海外だとそれで通ってるみたいなのに。。。

- 3貫

データセットを1貫と2貫で作っていたらスシローの3貫まつりがはじまった。ふぁっ。

3つそれぞれ違う皿で試しに使ってみたところ、真ん中のもので認識されるみたいです。

所感

いまいちなところはたくさんあるがひとまず完成した🎉。当社調べで個人開発の9割は完璧を求めて完成しないので完成してよかった。

Future Work

Androidいくか音声認識アプリ作るか